IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR)是人工智能领域的顶级国际会议,CCF A类会议。CVPR 2026 将于2026年6月3日-6月7日在美国丹佛举办,共有16,092篇论文进入评审流程,最终4090篇被接收,录取率为25.42%。厦门大学多媒体可信感知与高效计算教育部重点实验室共有30篇论文被录用,录用论文简要介绍如下(按第一作者姓氏拼音排序):

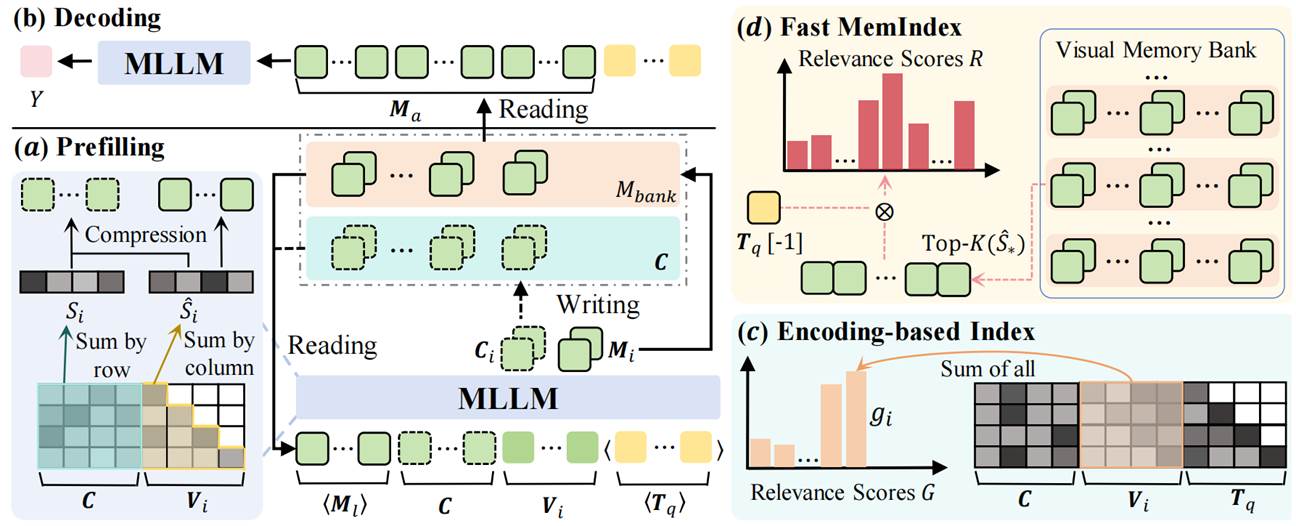

1. Scaling the Long Video Understanding of Multimodal Large Language Models via Visual Memory Mechanism

本文针对多模态大语言模型在长视频理解任务中因输入长度限制和计算开销过大而难以处理海量帧的问题,提出了名为 FlexMem (Flexible Memory) 的新型视觉记忆机制框架。该工作模拟人类看视频时形成连续记忆与回忆关键片段的行为,通过双路径压缩设计将视觉 KVCache转化为传递历史信息的上下文记忆和保留显著特征的局部记忆,实现了在有限显存下对无限长视频序列的迭代处理。同时,针对流式任务中的推理效率瓶颈,论文进一步提出了 MemIndex 快速索引机制,通过自适应选择代表性缓存层与构建轻量化索引,显著降低了从海量信息中检索的计算成本。实验表明,FlexMem实现了使用单张消费级显卡便能处理超过千帧甚至无限长的视频流。其现实意义在于:FlexMem 作为一种无需训练、即插即用的通用组件,不仅极大提升了现有 MLLM 对长达数小时视频的全局理解与细粒度检索能力,且凭借其高效的内存管理特性,证明了通往无限长视频理解的钥匙,不在于无限扩张的上下文窗口,而在于更聪明、更拟人的记忆机制 。

该论文第一作者为厦门大学信息学院人工智能系 2024 级博士研究生陈涛,通讯作者为周奕毅副教授。由2024级硕士研究生章锟、2022级博士研究生吴穹、陈潇博士后研究员和常超讲师(国防科大)共同合作完成。

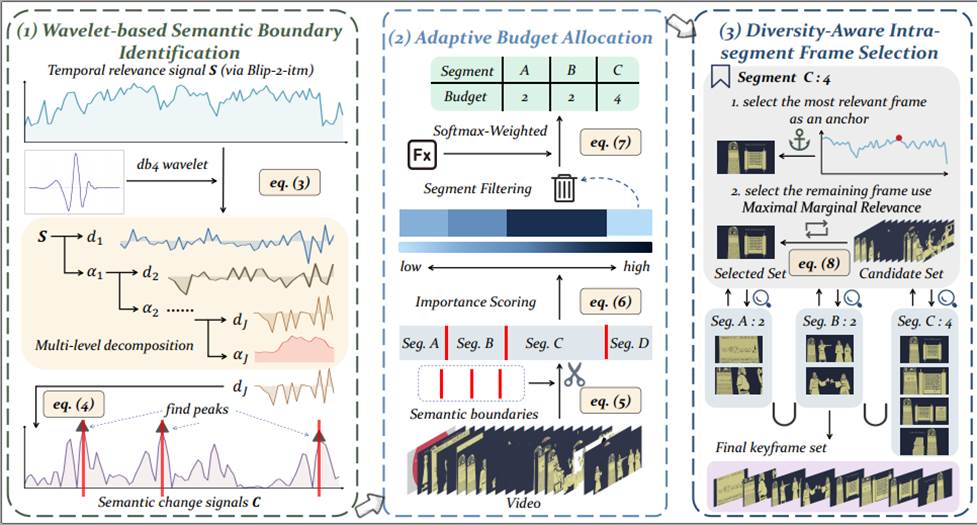

2. Wavelet-based Frame Selection by Detecting Semantic Boundary for Long Video Understanding

在长视频理解任务中,由于视频帧冗余度高且大模型上下文受限,高效的帧选择至关重要。现有方法通常倾向于选取孤立的查询相关帧,忽视了视频整体的叙事连贯性,且极易受到高频噪声的干扰。为此,本文提出了一种全新的无训练帧选择框架 WFS-SB。该方法创新性地引入信号处理视角,利用小波变换过滤查询-帧相似度信号中的噪声,精准识别语义边界,将长视频分割为语义连贯的“章节”片段。随后,通过自适应预算分配与段内多样性采样策略提取关键帧,在保留视频叙事完整性的同时兼顾重要性与多样性。实验表明,WFS-SB 显著提升了主流大模型在 VideoMME、MLVU 等长视频基准测试上的表现,最高提升达 9.5%,为长视频理解提供了一种全新的结构感知型帧选择范式。

该论文第一作者是厦门大学人工智能研究院2024级硕士研究生陈旺,通讯作者是郑侠武副教授,由2024级硕士生曾宇晖、2023级硕士生罗咏东、2025级硕士生谢天宇、林洛君副教授(福州大学)、纪家沂副教授、张岩工程师共同合作完成。

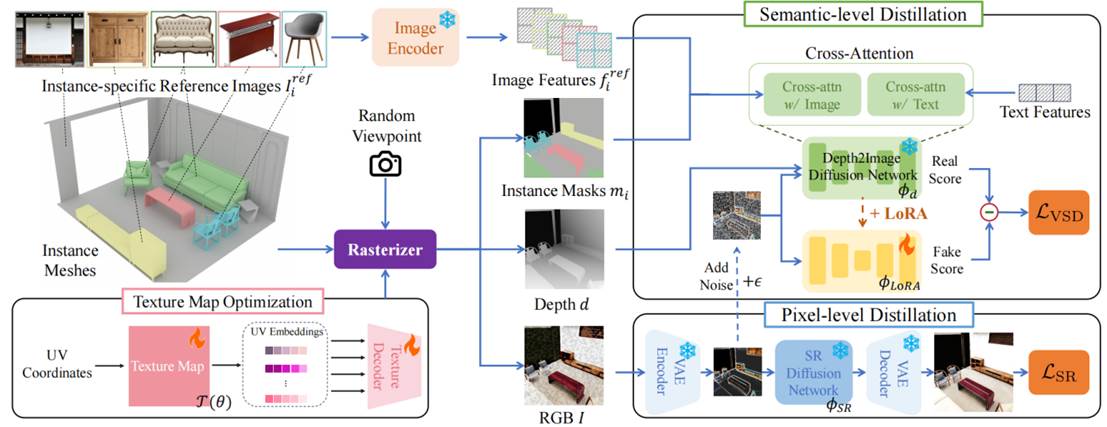

3. CustomTex: High-fidelity Indoor Scene Texturing via Multi-Reference Customization

创建高保真、可定制的3D室内场景纹理仍然是计算机图形学与数字化室内设计领域的一项重大挑战。虽然文本驱动的方法具有灵活性,但缺乏对细粒度实例级控制的精确性,且生成的纹理往往质量不足,存在瑕疵和预渲染阴影。为此,我们推出了CustomTex,这是一个由参考图像驱动的、用于实例级高保真场景纹理生成的新颖框架。CustomTex接收未添加纹理的3D场景以及一组为每个对象实例指定所需外观的参考图像,并生成统一的高分辨率纹理贴图。我们方法的核心是一种双蒸馏方法,可以将语义控制与像素级增强分离。我们采用配备了实例交叉注意力的语义级蒸馏技术,以确保语义合理性以及“参考-实例”对齐,并采用像素级蒸馏技术来确保高视觉保真度。语义控制和像素级增强两种机制被整合到同一个基于变分分数蒸馏的优化过程中。实验表明,CustomTex能够与参考图像实现精确的实例级一致性,并生成具有更高清晰度、更少瑕疵和最少预渲染阴影的纹理。本文工作为高质量、可定制的3D场景外观编辑开辟了一条更直接、更便捷的途径。

该论文第一作者为厦门大学2024级硕士研究生陈伟林,通讯作者为程轩助理教授。由2024级硕士研究生饶家豪、王文昊,2023级博士研究生李新阳,以及曹刘娟教授共同参与完成。

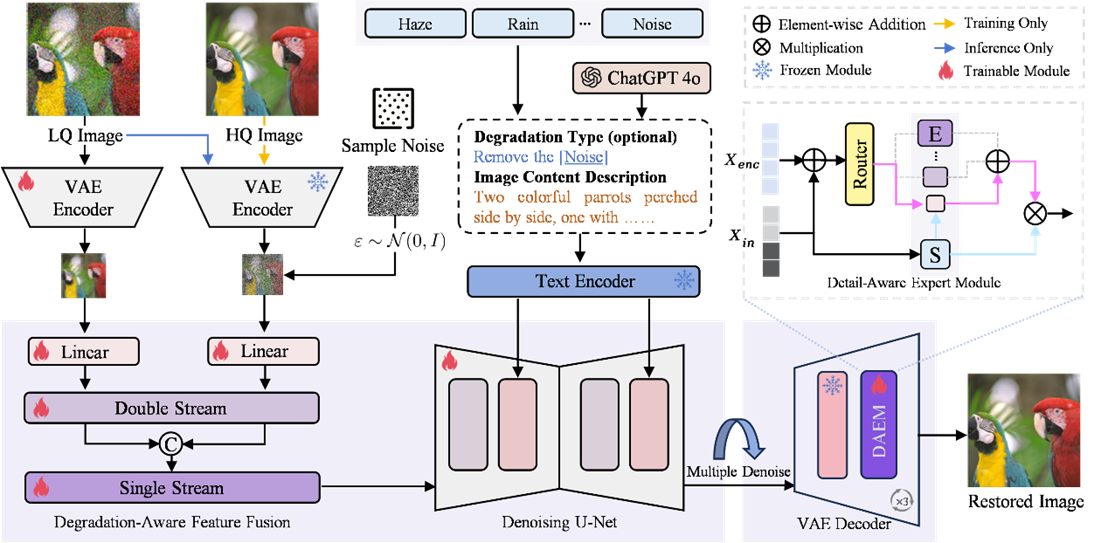

4. UniLDiff: Unlocking the Power of Diffusion Priors for All-in-One Image Restoration

预训练潜在扩散模型(如Stable Diffusion)展现出的卓越建模能力,有望为全能图像修复(All-in-One Image Restoration, AiOIR)任务提供强大的生成先验支持。为了在统一架构下精准适配多种退化并弥补恢复过程中的细节丢失,本文提出了 UniLDiff 框架。该框架通过引入退化感知特征融合机制(DAFF)与细节感知专家模块(DAEM),深度解锁扩散先验的修复潜力:DAFF通过解耦融合和自适应调制将低质量特征动态注入去噪迭代过程,实现对多钟退化的隐式建模与空间自适应引导;DAEM通过专家路由机制动态激活特定分支,利用多尺度特征补偿潜在空间压缩引起的信息损耗,显著提升纹理与细节的重建精度。实验结果表明,UniLDiff在多项修复任务及零样本未知退化场景下均取得了先进的性能,验证了扩散先验在通用图像修复领域中的巨大应用潜力。

该论文第一作者是厦门大学信息学院2024级硕士研究生程梓涵,共同通讯作者是曲延云教授和谢源教授(华东师范大学),由周亮太、陈典、唐妮、罗小同(香港理工大学)共同合作完成。

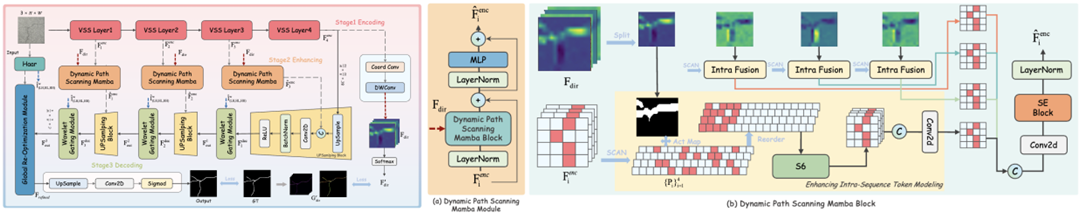

5. CrackSSM: Reviving SSMs for Crack Segmentation via Dynamic Scanning

本论文针对基础设施与工业场景中裂缝分割任务,提出了名为CrackSSM的新型状态空间模型框架,旨在解决现有Mamba类方法因静态扫描策略破坏空间连续性、难以有效建模不规则裂缝的问题。该工作创新性地引入动态扫描策略,依据高层语义特征的方向响应强度自适应重排token序列,使裂缝区域在序列中保持相邻,从而在保留SSM线性复杂度优势的同时增强其对细粒度裂缝的因果建模能力;同时结合小波引导解码机制,利用图像高频成分指导特征细化与边缘融合,进一步提升分割精度。实验表明,该方法在三个基准数据集上以更少参数量和更快推理速度实现了优于主流模型的精度表现。其现实意义在于:不仅可高效赋能桥梁、隧道、产线设备等场景的自动化巡检与预防性维护,降低人工成本与安全风险,且凭借轻量高效特性易于部署于无人机或嵌入式终端,满足边缘侧实时检测需求;此外,其"结构感知动态序列建模"的设计思路也为其他不规则细长结构分割任务提供了可迁移的技术范式,具有显著的工程应用价值与学术启发意义。

该论文共同第一作者为厦门大学信息学院2023级博士研究生谷雨斌和2022级本科生候博阳,通讯作者为孙晓帅教授。由纪家沂副教授、2024级硕士研究生孟媛,2023级本科生罗文婷共同合作完成。

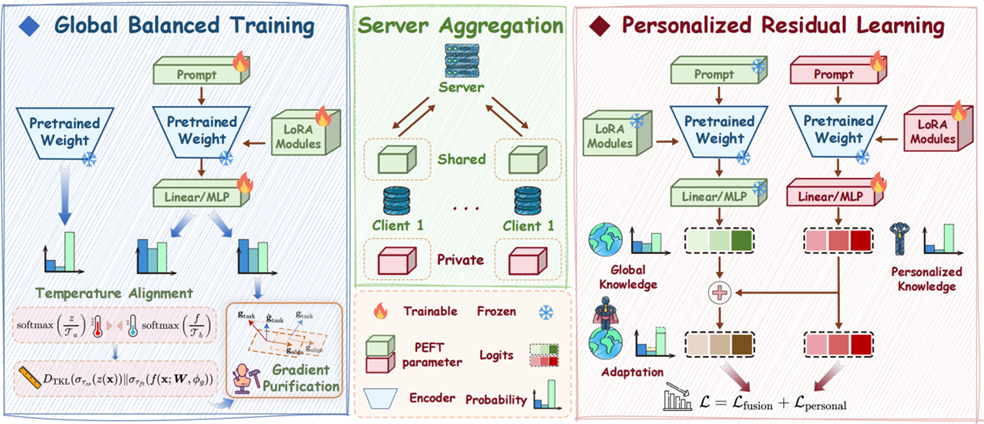

6. Fine-Tuning Impairs the Balancedness of Foundation Models in Long-tailed Personalized Federated Learning

在个性化联邦学习中,利用基础模型是应对客户端数据异构性的重要途径。然而,真实场景下往往同时面临非独立同分布与长尾分布的双重挑战。在异构长尾数据上直接微调会严重侵蚀基础模型原生的零样本知识平衡性;同时,现有的融合式个性化方法不仅无法解决该问题,还会将这种全局偏差放大并传递给客户端,进一步损害识别性能。为此,本文提出一种新的个性化联邦学习方法FedPuReL。该方法首先对下游任务的更新梯度进行提纯,剔除对模型原生平衡性具有负面影响的梯度,使全局模型保持良好的平衡性;进一步地,构建残差式个性化模型,使客户端在平衡的全局模型基础上进一步学习个性化知识,从而在适配本地数据的同时兼顾知识平衡性。实验结果表明,该方法在多个联邦长尾基准数据集上能够同时提升全局模型与个性化模型的性能表现,显著优于现有SOTA方法。

该论文第一作者是厦门大学信息学院2024级硕士研究生侯世豪,通讯作者是卢杨长聘副教授,并由2025级硕士生尚驰凯、2025级硕士生杨知衡、2025级博士生杨嘉诚、尚心怡(UCL)、高俊龙助理教授、张逸群(广东工业大学)共同合作完成。

7. MSGNav: Unleashing the Power of Multi-modal 3D Scene Graph for Zero-Shot Embodied Navigation

简介:现有零样本导航方法在构建显式三维场景图的过程中将丰富的视觉信息压缩为纯文本的目标关系。这一过程导致了构建成本高昂、视觉证据不可逆丢失以及场景图词汇表受限等问题。为解决这些问题,本文首先提出了多模态三维场景图(M3DSG),通过动态分配图像替代文本关系边来保留丰富的视觉线索。基于多模态三维场景图,进一步开发了零样本导航系统MSGNav来执行更高效准确的导航。此外,本文进一步识别出零样本导航中的“最后一公里”难题——如何确定具有最优目标视野的可行导航点,并提出基于可见性的视角决策模块来明确解决该问题。实验结果表明,MSGNav在具有挑战性的GOAT-Bench和HM3D-ObjNav基准测试中均取得业界领先水平。代码即将开源:https://github.com/ylwhxht/MSGNav

该论文第一作者是信息学院2024级博士生黄勋,通讯作者是温程璐教授、李伟欣副教授(北京航空航天大学)。并由赵世佳,张万发,王蕴红教授(北京航空航天大学)等共同合作完成。

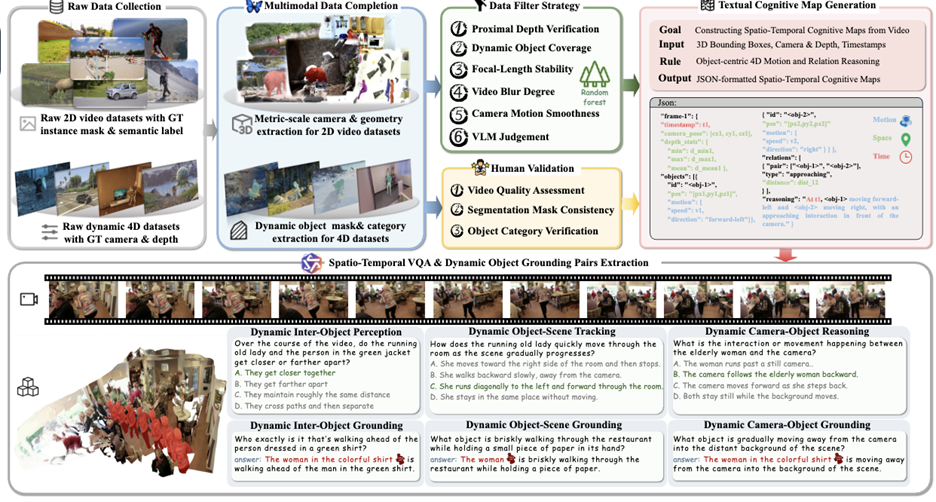

8. Thinking in Dynamics: How Multimodal Large Language Models Perceive, Track, and Reason Dynamics in Physical 4D World?

人类每天都生活在一个动态演变的4D世界中——物体在移动、场景在变化、时间在流逝。人类可以轻松地判断两辆车是在靠近还是远离,可以预测一个行人何时会走出画面,也能理解摄像机的移动如何影响我们对深度的感知。这种"在动态中思考"的能力,对人类而言如此自然,然而把同样的问题抛给当前最强大的多模态大模型时,答案却令人意外。这些在静态图像理解上已经接近人类水平的模型,在面对时空动态推理时却显得力不从心。它们可以准确描述一帧画面中的物体,却难以追踪这个物体在连续帧中的运动轨迹;它们能够识别空间关系,却无法推理这种关系如何随时间演变。现有的基准几乎都停留在场景级别的粗粒度评测,缺乏对动态物体的细粒度追踪与定位能力的考察。为此,本文提出一个根本性的问题:多模态大模型究竟能否像人类一样,在动态中感知、在变化中追踪、在演变中推理?为了回答这个问题,本文构建了Dyn-Bench——一个专注于动态理解的大规模基准,旨在全面探索MLLM的时空推理边界。

该论文第一作者是厦门大学信息学院2023级硕士生黄誉之,通讯作者是黄悦教授,并由2023级硕士生温凯润、2025级硕士生高荣鑫、2025级硕士生刘东暄、王智教授(清华大学)、姜婧妍助理教授(深圳技术大学)共同合作完成。

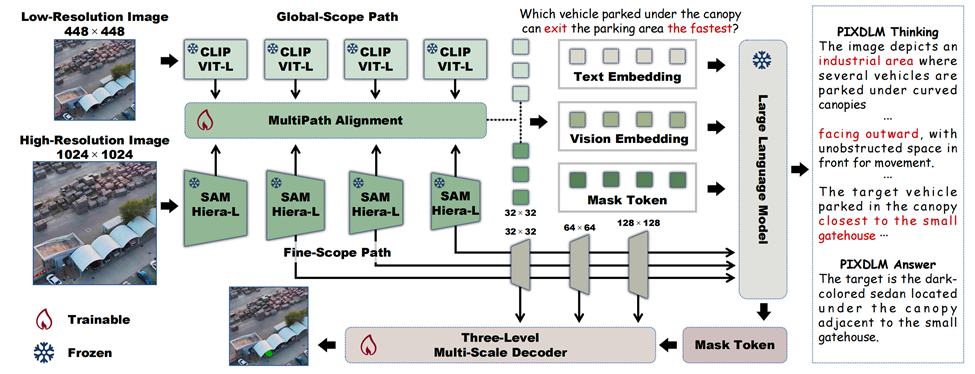

9. PixDLM: A Dual-Path Multimodal Language Model for UAV Reasoning Segmentation

推理分割最近已从地面场景扩展到遥感图像领域,这给无人机影像带来了全新的挑战,如倾斜视角、超高分辨率以及目标极端尺度变化等问题。针对这些无人机数据的特有属性,本文定义了无人机推理分割任务,并将其语义需求归纳为三个层次:空间推理、属性推理与场景级推理。基于这一框架,本文构建了首个大规模无人机推理分割基准DRSeg,其包含了1万张高分辨率航拍图像,并提供了涵盖上述三类推理任务的思维链问答标注。此外,论文进一步提出PixDLM,这是一种像素级多模态大语言模型,配备双路径视觉编码器,能够在保持强大全局语义对齐的同时保留细粒度的高分辨率线索。在DRSeg上的大量实验表明,与现有其他多模态模型相比,PixDLM实现了更优的语义一致性和空间定位精度,为无人机推理分割建立了统一高效的基准。

该论文第一作者是厦门大学人工智能研究院2024级硕士生柯殊言,通讯作者是纪荣嵘教授,由2025级硕士生梅一樊、2024级博士生吴昌鲡、2022级本科生郑永涵、纪家沂副教授、曹刘娟教授共同合作完成。

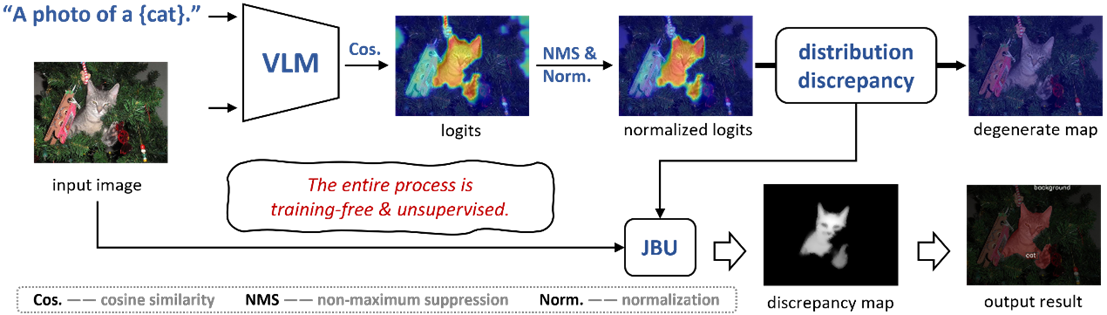

10. Direct Segmentation without Logits Optimization for Training-Free Open-Vocabulary Semantic Segmentation

开放词汇语义分割旨在利用开放词汇提示分割图像中的任意类别区域,这就要求现有方法具备像素级的视觉-语言对齐能力。通常,这种能力涉及计算视觉特征和语言特征之间的余弦相似度(即logits),并最小化logits与真实值(GT)之间的分布差异,从而生成最优logits,进而用于构建分割图。然而,这种方法依赖于耗时的迭代训练或模型特定的注意力机制。本文提出了一种更直接的方法,通过直接推导分割图的解析解来避免logits优化过程。我们提出了一个关键假设:分布差异编码了语义信息;具体而言,这种差异在同一类别的图像块之间表现出一致性,但在不同类别的图像块之间表现出不一致性。基于此假设,我们直接利用这种分布差异的解析解作为语义图。换句话说,我们将分布差异的优化重新表述为推导其解析解,从而消除了耗时的迭代训练,使我们摆脱了模型特定的注意力调节,并在八个基准数据集上实现了最先进的性能。

论文第一作者是厦门大学信息学院2023级博士生李佳豪,通讯作者是其导师曲延云教授和张亚超助理教授(厦门大学)。

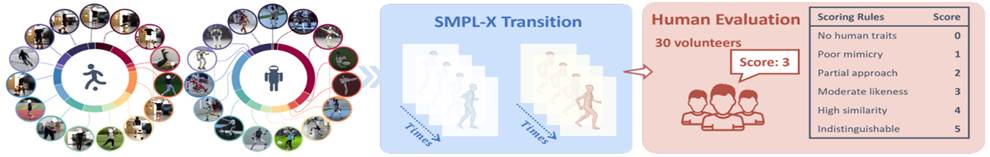

11. Towards Motion Turing Test: Evaluating Human-Likeness in Humanoid Robots

近年来,人形机器人在运动生成与控制方面取得了显著进展,动作看起来越来越自然,但“是否真的像人类”仍缺乏统一评估标准。本文受图灵测试启发,提出了Robot Motion Turing Test(机器人行为图灵测试),通过仅保留运动学信息,让人类判断动作来源,从运动学角度评估机器人运动的类人程度。同时,本文构建了首个包含人类与人形机器人同类动作数据且包含人类评分标注的HHMotion 数据集,并进一步提出自动预测动作类人度的基准任务与模型。研究发现,即使在视觉外观因素被消除的情况下,当前机器人动作仍与人类存在明显差距,尤其在跳跃、拳击等高动态场景中更为突出。该工作为机器人行为图灵测试提供了以运动为中心的评估新范式,也为未来更自然的机器人运动生成奠定了基础。

该论文第一作者是信息学院2025级博士生李明哲、2024级硕士生刘梦茵,通讯作者是沈思淇长聘副教授。并由吴泽凯、林心成、张俊圣、颜明、谢曾烨、张长旺(OPPO研究院)、温程璐教授、许岚助理教授(上海科技大学)、王程教授共同合作完成。

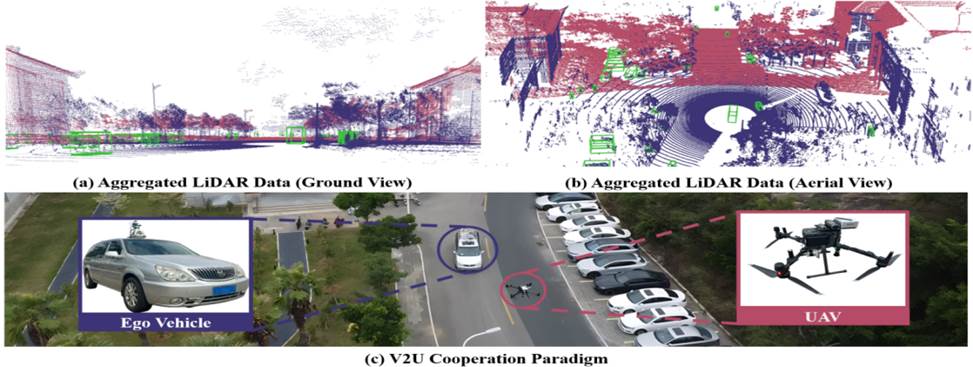

12. V2U4Real: A Real-world Large-scale Dataset for Vehicle-to-UAV Cooperative Perception

自动驾驶感知系统通常受限于遮挡、盲区以及有限的感知范围。已有的车车协同和车路协同范式感知主体为地面视角,难以有效应对大规模遮挡与远距离感知需求。本文提出首个面向车与无人机协同目标感知的大规模多模态真实场景数据集V2U4Real。V2U4Real由搭载有激光雷达与RGB相机的地面车辆与无人机协同采集,采集场景覆盖城市街道、校园以及乡村道路等多种交通环境,共包含超过56K帧激光雷达数据、56K张多视角相机图像,涵盖四类目标的70万个三维标注框。此外,本文构建了单智能体三维目标检测、协同三维目标检测以及多目标跟踪等基准任务。对多种当前先进模型的评估结果表明,车与无人机协同感知可显著提升复杂场景感知鲁棒性与远距离感知能力。

该论文第一作者是信息学院2025级硕士生23级硕士生项浩恩,通讯作者是温程璐教授。并由王天旭、吴帅兵、夏启明、王程教授共同合作完成。

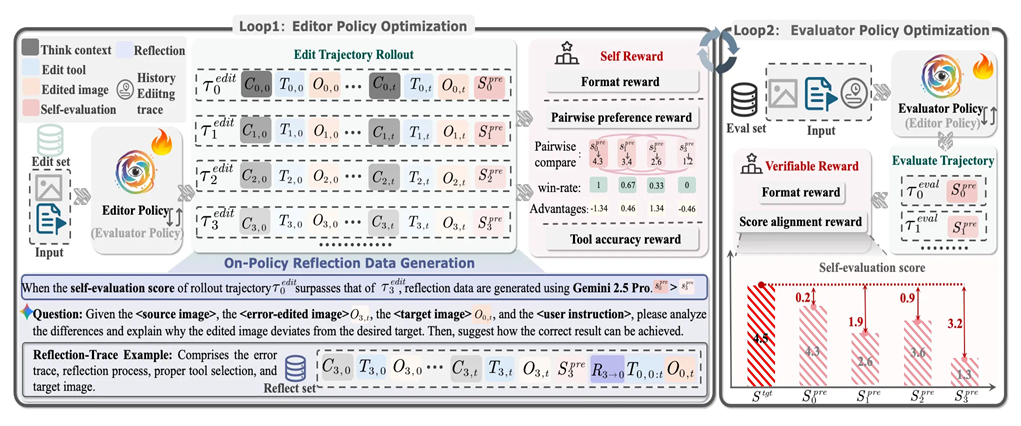

13. JarvisEvo: Towards a Self-Evolving Photo Editing Agent with Synergistic Editor-Evaluator Optimization

现有的 Image Editing Agent,真的“懂”修图吗?是在迈向通用人工智能的道路上,一直在思考一个问题。大多数基于 LLM/VLM 的智能体,本质上更像是一个“盲目的指挥官”。它们能流利地写出修图代码或调用 API,但在按下回车键之前,它们看不见画布上的变化,也无法像人类设计师那样,盯着屏幕皱眉说:“这张对比度拉太高了,得往回收到一点。”这种感知与决策的割裂,直接导致了‘指令幻觉’,或者说模型在进行盲目的‘脑补’。由于缺乏视觉反馈,模型往往凭空想象下一步操作,导致结果与用户的初衷南辕北辙。此外,在传统强化学习中经常依赖于静态的奖励模型。随着模型的不断训练,它很容易学会如何“讨好”这个固定的打分器,导致 Reward Hacking——即分数很高,但审美并没有真正提升。 为了打破这一僵局,JarvisEvo 应运而生。它不仅仅是一个连接 Adobe Lightroom 的自动化工具使用者,更是一次大胆的探索:探索 Agent 如何通过“内省”,真正实现自我进化。

该论文第一作者为厦门大学信息学院 2023 级硕士研究生林云龙、林子旭,以及 2024 级硕士研究生林坤杰,通讯作者为丁兴号教授,并由腾讯混元研究员王林青、王春雨、卢清林共同合作完成。

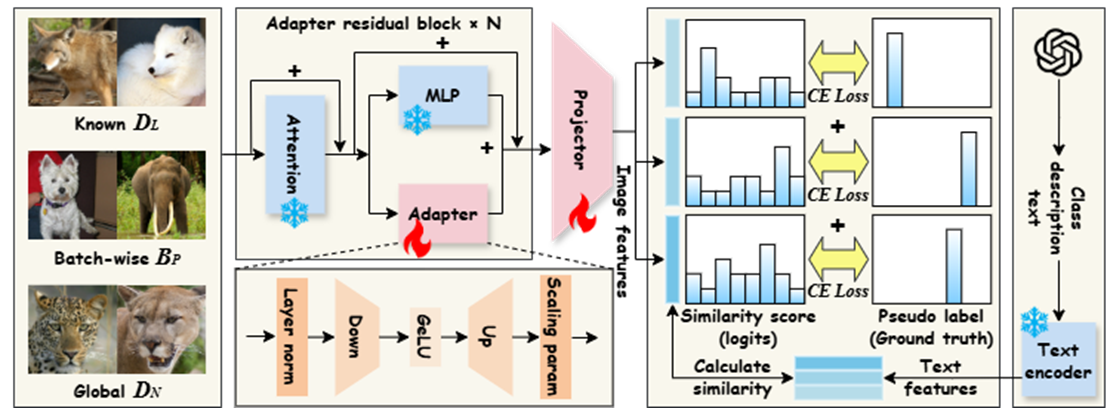

14. SECOS: Semantic Capture for Rigorous Classification in Open-World Semi-Supervised Learning

在开放世界半监督学习中,模型从包含已知类别和未知类别的有标签数据和无标签数据中学习。在实际的开放世界半监督学习应用中,模型需要通过直接选择候选标签集中与输入样本语义上最相关的标签来执行严格的分类。现有的开放世界半监督学习方法未能实现这一点,因为未知类样本是在没有明确监督信号的环境下训练的,这些方法缺乏提取潜在语义信息的机制,导致其预测的标签与候选文本标签没有语义上的对应关系。为了解决这一问题,本文提出了开放世界半监督学习的语义捕获框架SECOS,它无需后处理即可直接从候选标签集中预测文本标签,从而满足实际开放世界半监督学习应用的需求。SECOS利用外部知识捕获已知类别和未知类别潜在的语义信息,并让模型建立起样本视觉特征和潜在文本特征的匹配关系,为未知类别样本的训练提供显式监督信号。大量实验表明,即使在更宽松的后处理设置下评估现有的开放世界半监督学习方法,而SECOS在没有后处理辅助的情况下仍然比他们的整体性能高出5.4%。

该论文第一作者是厦门大学信息学院2023级硕士生刘赫昭,通讯作者是卢杨长聘副教授,由2025级博士生杨嘉诚、高俊龙助理教授以及李梦柯(深圳大学)、张逸群(广东工业大学)、Shreyank N Gowda(英国诺丁汉大学)共同合作完成。

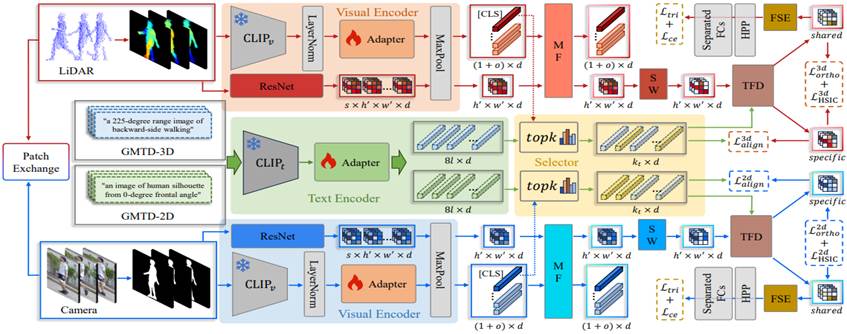

15. Text-guided Feature Disentanglement for Cross-modal Gait Recognition

简介:步态识别在远距离和非侵入式身份验证场景中具有显著优势。由于激光雷达和RGB相机等异构传感器的数据间存在模态鸿沟,跨模态步态识别极具挑战性。为此,本文提出了一种文本引导的跨模态特征解耦网络TCFDNet,利用感知模态的文本先验作为语义锚点来引导特征学习。首先,利用大语言模型构建步态模态文本字典(GMTD)以生成跨模态与视角的丰富语义描述,并采用基于CLIP的多粒度特征编码器在统一的视觉-语言空间中对齐视觉与文本特征;其次,设计文本引导的特征解耦(TFD)模块,选取最佳匹配文本重建模态特定表示,并通过残差分解与正交性约束提取模态共享特征;最后,提出特征稳定性增强(FSE)模块以建模空间和通道相关性,并引入跨模态块(Patch)交换策略,有效提升了解耦特征的鲁棒性与模型的泛化能力。在SUSTech1K和FreeGait数据集上的实验表明,TCFDNet达到了全新的SOTA性能。

该论文第一作者是信息学院2024级博士生陆志阳,通讯作者是程明教授。

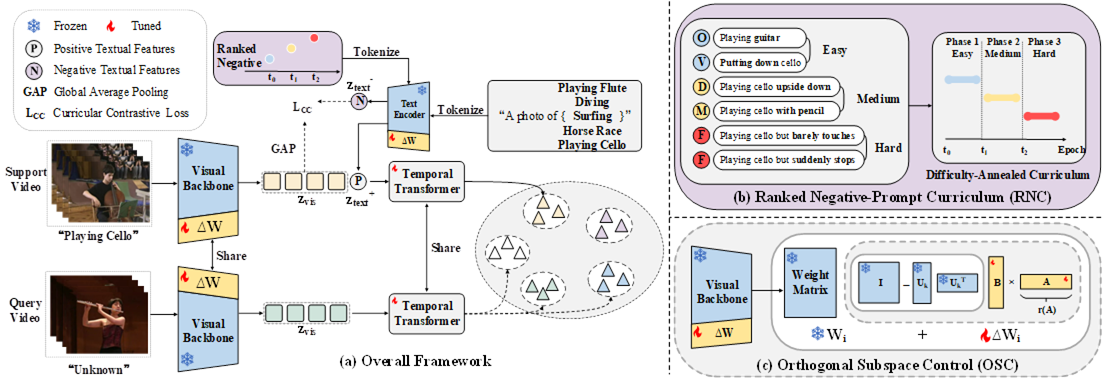

16. Protect to Adapt: Subspace-Constrained Adaptation with Ranked Negative Prompt Feedback for Few-Shot Action Recognition

将视觉语言模型适配到小样本动作识别任务时,往往需要在准确率与稳定性之间做权衡:面向特定任务的性能提升可能会触发对领域通用知识的灾难性遗忘,并降低类别间的区分度。在小样本任务的 episode 中,每个查询样本通常只与一个正类以及少量负类进行对比,使得文本编码器接触到的提示多样性有限,也较少在决策边界附近看到困难反例。因此,本文提出一种P2A (Protect-to-Adapt) 微调方法,通过估计预训练骨干网络的主语义子空间,并将低秩更新约束在其正交补空间内,从而在允许任务特定适配的同时保留领域通用语义。同时,利用大语言模型生成经过验证器筛选、难度逐步递增的负提示。这些类别相关的困难反例能够在小样本条件下扩大类间间隔、锐化决策边界。在仅训练骨干网络 2% 参数的情况下,P2A 在五个 FSAR 基准上达到最先进性能,并在跨数据集的持续学习设置中显著缓解灾难性遗忘:模型无需回放,即可依次适配多个视频数据集。

该论文第一作者是厦门大学人工智能研究院2024级博士生齐汉涛,通讯作者是王菡子教授,由严严教授与高俊龙助理教授共同合作完成。

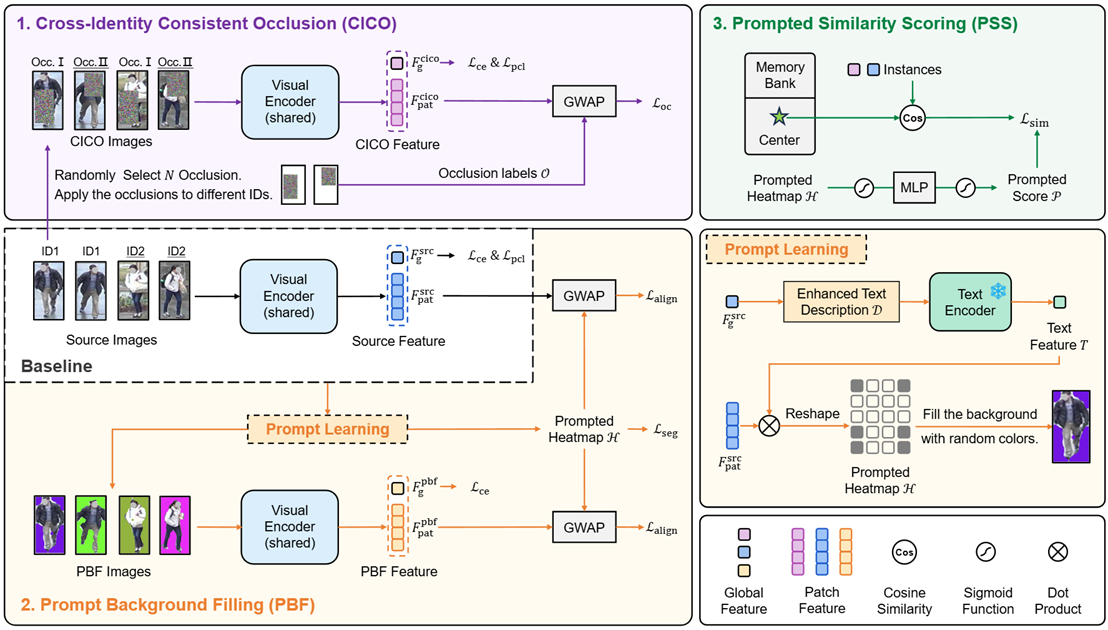

17. COPE: Consistent Occlusion and Prompt Enhancement Network for Occluded Person Re-identification

遮挡为行人重识别(Re-ID)带来了特征干扰与信息丢失两大关键挑战,现有研究虽已通过感知遮挡的数据增强和特征重建等方法尝试缓解,但前者往往难以应对相似的遮挡模式与背景干扰引发的错误匹配,后者则常伴随显著的计算开销。为此,本文提出一致遮挡与提示增强网络(COPE),该网络通过跨身份一致遮挡模块(CICO)对不同身份施加相同遮挡并鼓励其在遮挡区域的特征相似性,以抑制遮挡引起的特征干扰;同时借助提示背景填充模块(PBF)利用视觉——语言对齐生成前景热力图并执行随机背景填充,增强模型在复杂背景下的特征鲁棒性;此外,轻量级提示相似度赋分模块(PSS)进一步通过提示引导的可靠性评分对检索相似度进行精细化校准。在包含遮挡与非遮挡的6个行人重识别基准数据集上的大量实验表明,COPE始终优于现有方法,尤其在极具挑战性的 Occluded-DukeMTMC数据集上取得了82.4%的Rank-1准确率与76.4%的mAP,充分验证了该方法的有效性与泛化能力。

该论文第一作者是2023级硕士研究生孙斯益,通讯作者是罗志明副教授。由林金亮,翁娟娟(暨南大学),刘志辉(真景科技),李绍滋教授共同完成。

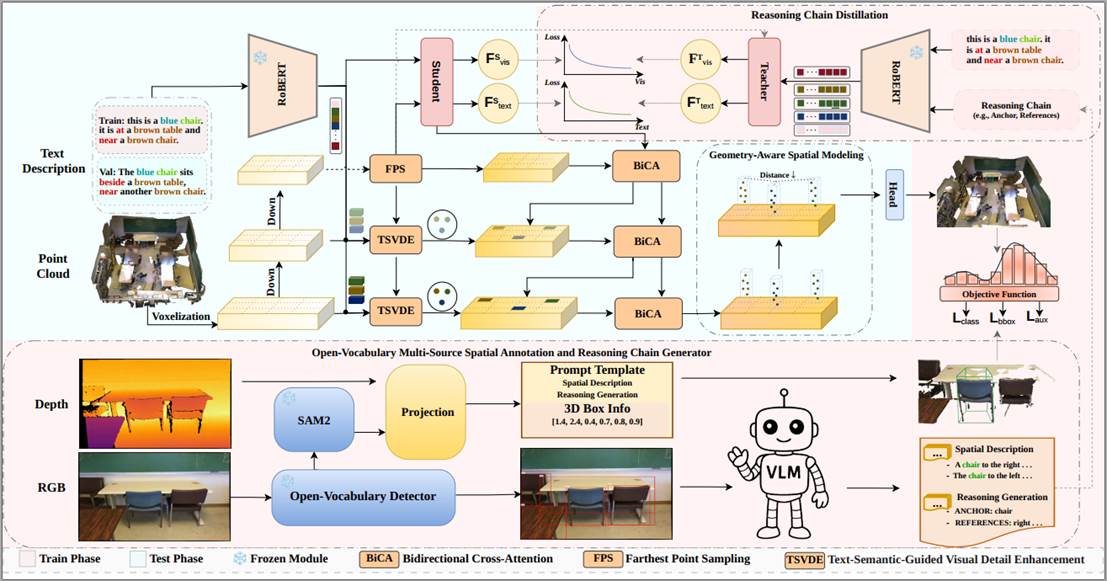

18. UZ3DVG: Unaided Zero-Shot 3D Visual Grounding with Generated Language Conditions

零样本三维视觉定位(Zero-Shot 3DVG)旨在不依赖人工实例级描述标注的条件下,根据自然语言描述在三维场景中定位目标物体。针对现有方法在推理阶段依赖额外2D图像输入,或需要与LLM/VLM进行多轮交互而导致推理延迟高、计算开销大、部署复杂度高的问题,本研究提出了基于生成语言条件的无辅助零样本三维视觉定位方法(UZ3DVG):在推理阶段仅使用三维点云和文本描述,不依赖外部模型。在训练阶段,本团队设计了开放词汇多源空间标注与推理链生成器,从开放场景中的RGB-D图像或3D投影的2D图像生成空间伪标签与推理链,以训练一个具备稳健空间推理能力的轻量级3DVG模型。对此,本研究通过推理链蒸馏模块(RCD),将较大的教师网络提取的推理知识迁移到轻量级学生网络,并引入几何感知空间建模(GeoSM)模块联合建模全局与局部几何关系,辅助文本推理与3D空间结构对齐,进一步提升模型空间推理及定位能力。实验结果表明,UZ3DVG在ScanRefer和NR3D上取得零样本SOTA性能,推理速度达7.69 FPS,约为现有SOTA方法的38倍,建立了开放场景下零样本3DVG的新范式。

该论文第一作者为厦门大学信息学院2024级博士生谭文斌,共同通讯作者为张亚超助理教授和曲延云教授;论文由2024级硕士生林嘉文与华东师范大学谢源教授共同完成。

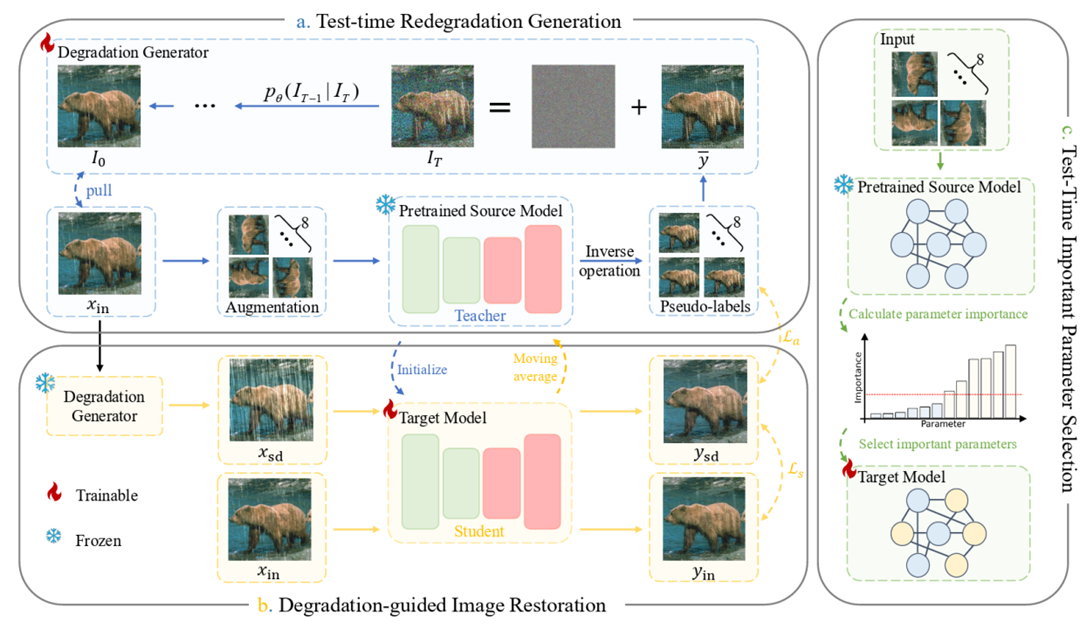

19. Degradation-Consistent Test-Time Adaptation for All-in-One Image Restoration

一体化图像恢复(AiOIR)方法在处理多种退化方面已取得了显著进展。然而,当测试分布偏离训练分布时,其性能往往会明显下降。因此,探索面向 AiOIR 的测试时自适应方法具有重要意义。为了在不访问源数据、也不进行重新训练的情况下,使预训练的 AiOIR 模型适应未见过的退化分布,需要解决两个关键挑战:一是设计可靠的伪监督信号,二是稳定自适应过程。基于这样一个观察:同一场景的多个退化版本应当映射到一致的干净图像,本文提出了退化一致性的测试时自适应方法(Degradation-Consistent Test-Time Adaptation, DCTTA)。DCTTA 包含三个核心组成部分:(1)测试时再退化生成,通过基于扩散模型的生成器构建伪退化–干净图像对,以实现分布对齐;(2)退化引导的图像恢复,通过自监督一致性损失实现域自适应;(3)测试时重要参数选择,有选择地更新对退化敏感的参数,从而在保持预训练知识的同时确保自适应过程的稳定性。在多个任务和具有挑战性的分布偏移场景下的大量实验表明,DCTTA 相比当前最先进的 AiOIR 基线方法具有稳定优势,在 Rain100H 数据集上最高可实现 +4.57 dB 的 PSNR 提升。

该论文共同第一作者为厦门大学信息学院2024级博士唐妮和2023级硕士聂声豪,通讯作者为曲延云教授和谢源(华东师范大学),由罗小同(香港理工大学)共同合作完成。

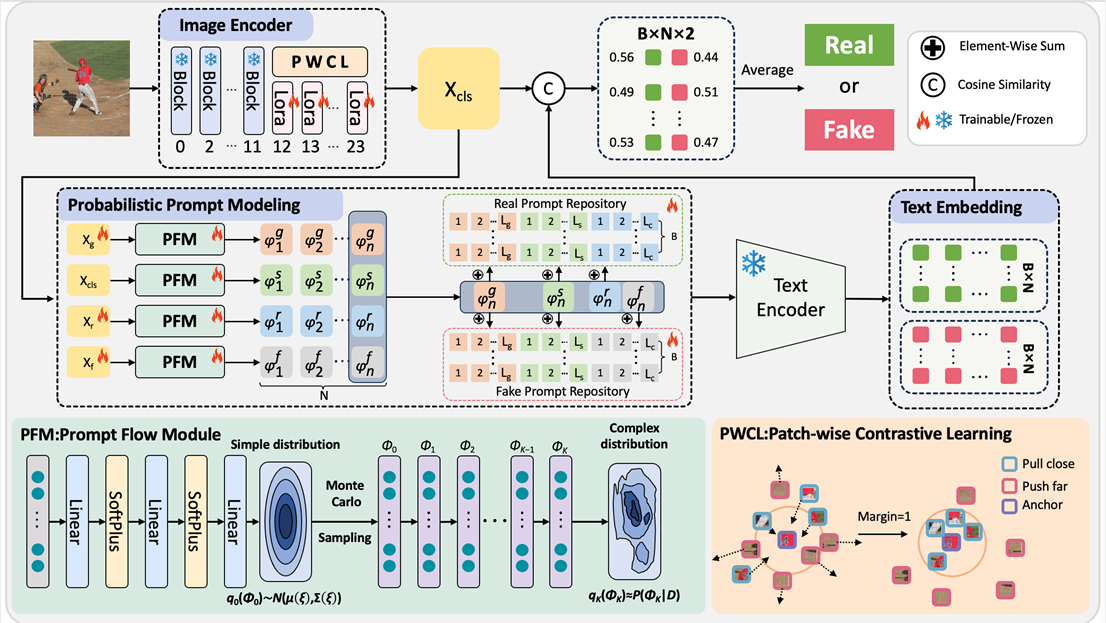

20. PPM-CLIP: Probabilistic Prompt Modeling for Generalizable AI-Generated Image Detection

高度逼真的AI生成图像的迅速涌现,亟需可靠且可泛化的检测方法。然而,现有方法受限于其判别性质:它们通过学得一个静态决策边界,容易记忆生成模型特定的伪影,导致难以泛化到未知生成模型的新数据分布。为克服这一局限,本文提出了PPM-CLIP,这是一种基于CLIP视觉语言模型的新框架,从静态分类转向条件生成建模。该方法不再学习固定决策边界,而是通过一个概率提示(Probabilistic Prompt Modeling)建模模块作为生成器,根据输入图像生成自适应的提示分布。这使得模型能够灵活捕捉新颖的伪影,而非将它们与固定模板进行匹配;此外,为了增强视觉编码器对细微伪影的敏感性,引入了patch级对比学习策略。在Ojha、GenImage和DRCT等基准数据集上的实验表明提出的生成式检测范式在性能上显著优于当前最先进的方法,尤其在跨域检测任务中表现突出。

该论文的共同第一作者是2024级硕士生汪欣源2024级博士生赖映鑫,通讯作者是罗志明副教授,并由刘志辉(真景科技)共同完成。

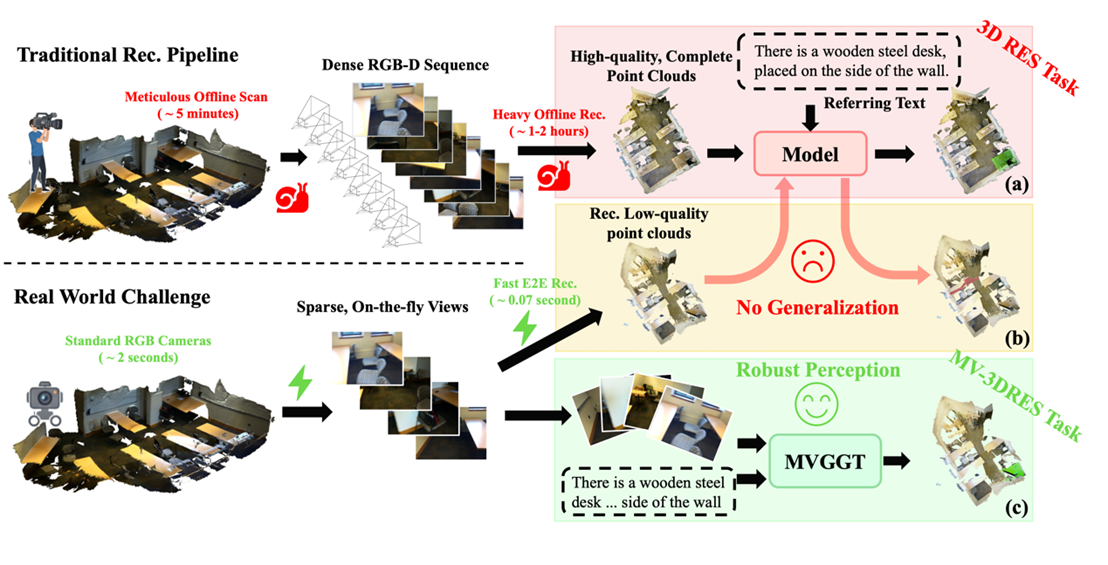

21. MVGGT: Multimodal Visual Geometry Grounded Transformer for Multiview 3D Referring Expression Segmentation

针对机器人等移动设备在稀疏视角下 3D 感知难、延迟高的痛点,研究团队提出了一种全新的多视角 3D 指代对象分割(MV-3DRES)框架——MVGGT。该框架摒弃了传统低效的“先重建再分割”模式,通过端到端的双支路设计将语言深度融入几何推理,并创新性地利用 PVSO 优化算法解决了稀疏信号下的梯度稀释问题;配合同步推出的 MVRefer 标准基准,MVGGT 在实现高精度定位的同时显著提升了推理速度,为复杂真实场景下的多模态空间感知树立了新的性能标杆。该项目已开源,项目主页为:https://mvggt.github.io/

该论文的共同第一作者是厦门大学人工智能研究院2024级博士生吴昌鲡和信息学院2023级本科生王浩东,通讯作者是纪家沂副教授,由曹刘娟教授等共同合作完成。

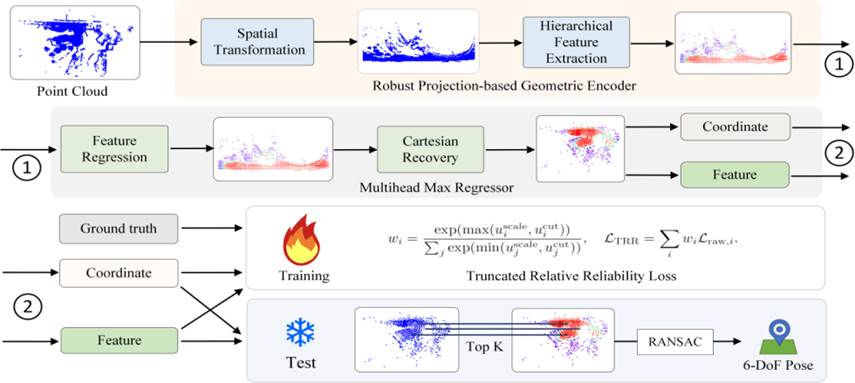

22. LEADER: Learning Reliable Local-to-Global Correspondences for LiDAR Relocalization

激光雷达重定位能够在复杂三维环境中提供精确的六自由度位姿估计。现有基于学习的回归方法通过直接预测全局位姿来提供高效解决方案,无需显式存储地图。然而,这类方法在复杂场景中往往表现欠佳,主要原因是它们对所有预测点采用同等权重处理,导致容易受噪声和外点影响。本文提出一种基于几何编码器增强的鲁棒激光雷达定位方法LEADER。具体来说,提出一种基于投影的鲁棒几何编码器架构,通过捕获多尺度几何特征来增强几何表示的描述能力;此外设计了TRR损失函数,建模点的可靠性并抑制不可靠预测的影响。在Oxford RobotCar和NCLT数据集上的实验表明,LEADER方法优于SOTA方法,分别降低了24.1%和73.9%的定位误差。

该论文第一作者是信息学院2023级硕士生吴建实,通讯作者是敖晟助理教授。并由朱明航、刘敦强、毕业生李文(布里斯托大学)、沈思淇副教授、温程璐教授、王程教授共同合作完成。

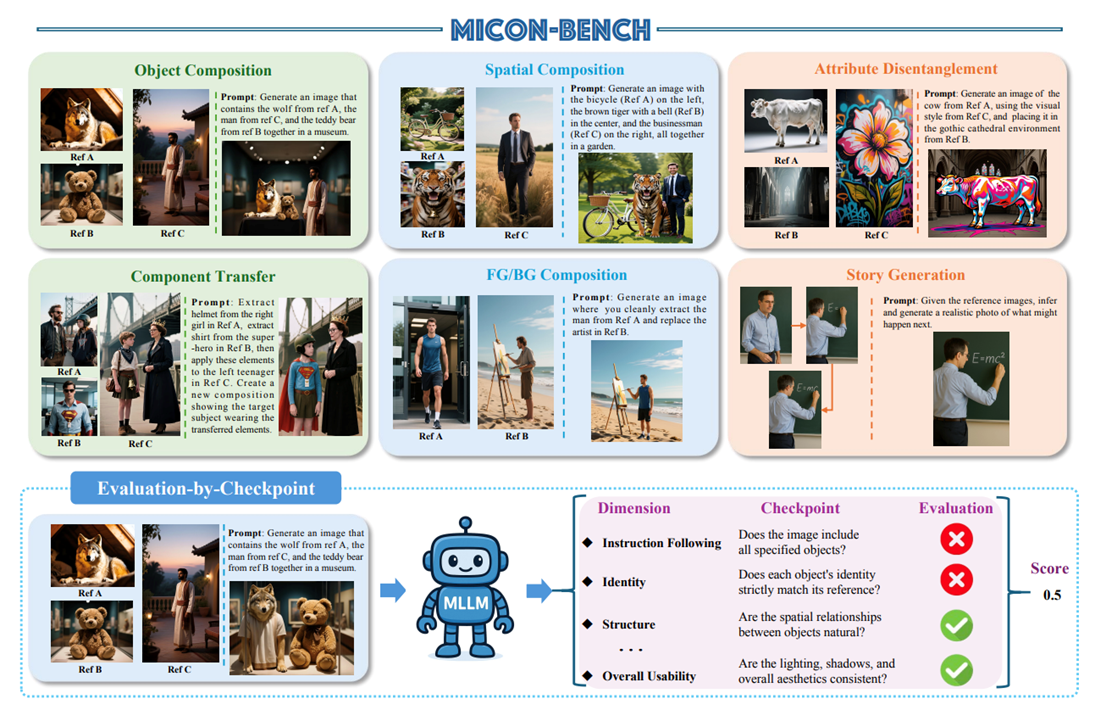

23. MICON-Bench: Benchmarking and Enhancing Multi-Image Context Image Generation in Unified Multimodal Models

在统一多模态模型(UMMs)飞速发展的今天,图像理解与生成能力已取得显著突破。然而,尽管如 Gemini 等模型已展现出对多张相关图像的推理能力,现有的基准测试仍主要局限于文本生成图像(T2I)或单图编辑任务,难以有效评估“多图像上下文生成”这一新兴领域的挑战。本文提出了一种全新的基准测试——MICON-Bench,旨在全面评估和提升模型在多图像语境下的生成能力。MICON-Bench 包含六大核心任务,涵盖了从基础的物体组合、属性迁移,到高阶的视觉故事生成等复杂场景,重点考察模型在跨图像组合、上下文推理及身份保持方面的表现。为了解决评估难题,本文设计了一套由多模态大语言模型(MLLM)驱动的“检查点评估”框架,能够自动且客观地验证生成内容在语义和视觉上的一致性。此外,针对现有模型在处理多图像输入时容易出现的注意力分散和幻觉问题,本文提出了一种名为动态注意力重平衡的创新机制。DAR 是一种无需训练、即插即用的方法,它能在推理过程中动态识别并增强与任务相关的图像区域关注度,同时抑制无关干扰。实验结果表明,MICON-Bench 有效揭示了当前最先进模型在多图像推理中的短板,而 DAR 显著提升了生成的连贯性与质量。这项工作不仅为多图像上下文生成提供了标准化的评估平台,也为未来更灵活、更精准的多模态生成模型指明了方向。

该论文共同第一作者是厦门大学人工智能研究院 2023 级博士生吴明瑞和信息学院本科生刘航,通讯作者是纪荣嵘教授,由孙晓帅教授、纪家沂副教授等共同合作完成。

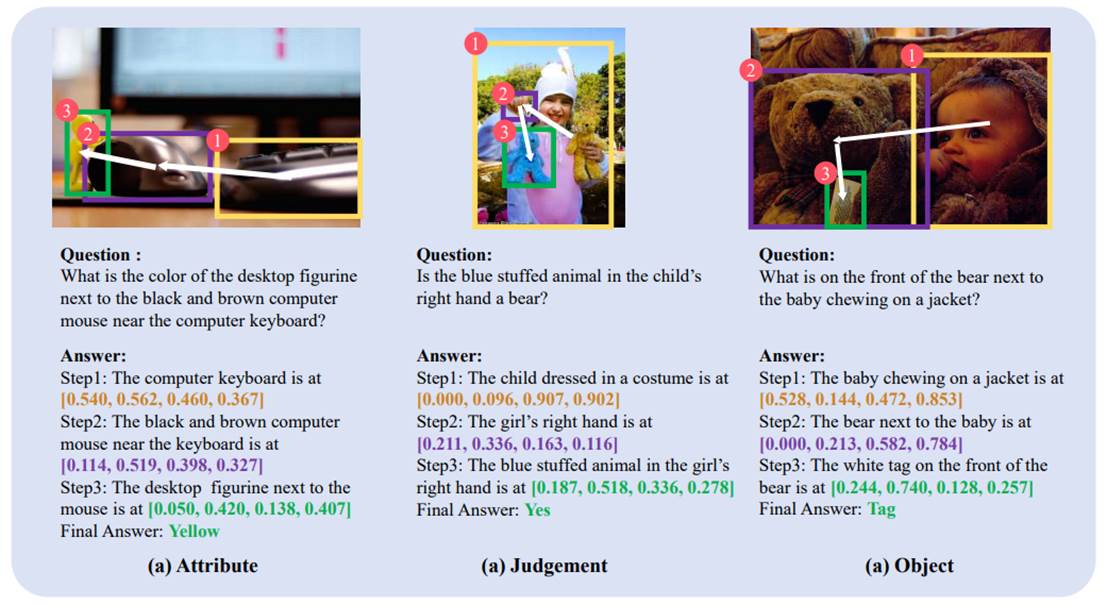

24. Grounded Chain-of-Thought for Multimodal Large Language Models

尽管多模态大语言模型取得了显著进展,但在视觉-空间推理方面仍存在明显不足,这严重制约了其在具身AI等场景中的可信应用。本文提出Grounded Chain-of-Thought (GCoT)任务,旨在通过逐步识别和定位相关视觉线索来提升模型的视觉-空间推理能力,每一步推理都以定位坐标作为直观依据。为支撑该任务,本文构建了MM-GCoT基准数据集,并建立了包含答案准确性、定位准确性和答案-定位一致性的综合评估体系。在12个先进MLLMs上的大量实验揭示了三个重要发现:多数模型在一致性评估上表现不佳,显示出明显的视觉幻觉问题;视觉幻觉与模型参数规模和通用多模态性能无直接关联;更大更强的模型并未显著减少视觉幻觉现象。本研究为评估和改进多模态大语言模型的视觉-空间推理能力提供了新的视角和工具,揭示了当前模型在可信度方面的关键缺陷。

该论文的第一作者是厦门大学人工智能研究院2022级博士生吴穹,通讯作者是纪荣嵘教授,由2024级硕士生杨祥聪、2025级硕士生方晨鑫、2025级硕士生宋柏杨、周奕毅副教授、孙晓帅教授共同合作完成。

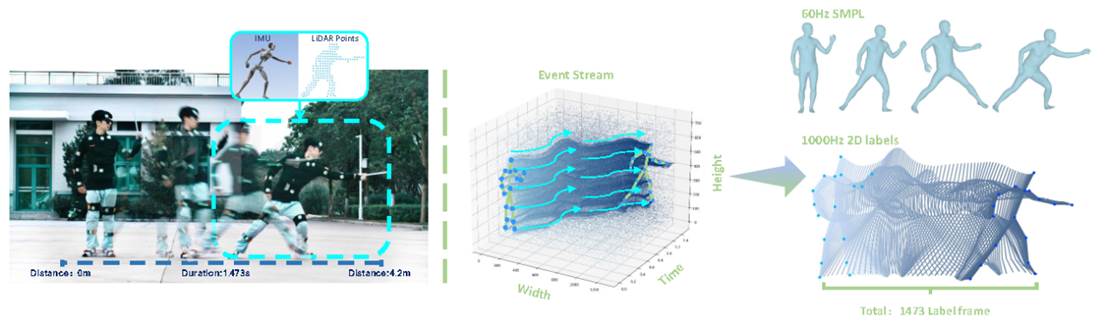

25. FlashCap: Millisecond-Accurate Human Motion Capture via Flashing LEDs and Event-Based Vision

毫秒级运动计时对快速运动分析至关重要,在体育竞技等场景中毫秒之差往往决定成败。受限于高帧率标注数据的匮乏,毫秒级运动计时在姿态估计领域长期被忽视,而现有专业高速相机方案成本高昂且难以普及、对光照敏感且计算复杂度高,难以在日常场景中普及。为此,本文提出首个基于闪烁LED的毫秒级运动捕捉系统FlashCap。首先,利用该系统构建了包含事件相机、RGB等多模态的人体运动数据集FlashMotion;其次,针对毫秒级运动计时和超快人体动作捕捉任务,设计了基线网络ResPose,通过融合事件流与RGB特征预测残差姿态。实验表明,ResPose将姿态误差显著降低了约40%并实现了毫秒级计时精度,为高频微动态分析开辟了新途径。

该论文第一作者是信息学院2024级硕士生吴泽凯、2023级硕士生范书琪,通讯作者是沈思淇长聘副教授。并由刘梦茵、罗裕华、林心成、颜明、吴俊豪、毕业生林修弘、马月昕副教授(上海科技大学)、温程璐教授、许岚助理教授(上海科技大学)、王程教授共同合作完成。

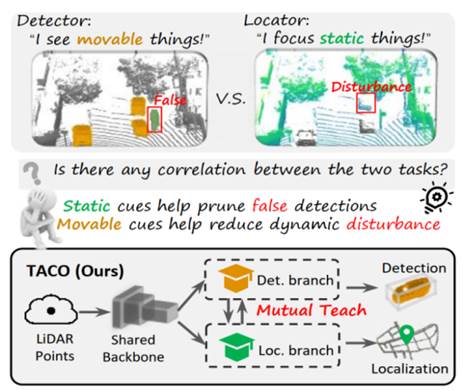

26. TACO: Task-Aware Contrastive Learning for Joint LiDAR Localization and 3D Object Detection

自车定位和目标感知是自动驾驶车和智能机器人的关键任务。激光雷达视觉定位是对GNSS定位系统的有效补充手段。现有系统通常将定位与检测模型分离设计、分别优化,这导致计算冗余,也限制了跨任务知识迁移的潜力。此外,两项任务在语义关注与几何先验上存在差异,导致特征表示层面产生冲突,简单共享特征的多任务训练会导致性能下降。针对以上问题,本文提出了一种视觉定位和目标检测多任务学习框架TACO,通过对静态场景的几何结构特征与可移动目标的语义判别特征进行解耦,从而建立两个任务在同一框架下的协同关系。论文进一步构建了OxfoLD数据集以支撑训练与评估,实验结果表明,TACO在定位和检测性能上均有显著提升。

该论文第一作者是信息学院2023级博士生邢乐园、2025级硕士生张桓嘉,通讯作者是温程璐教授、王程教授。并由潘东屿,毕业生吴海(鹏城实验室),夏启明,熊恪峥,毕业生李文(布里斯托大学)共同合作完成。

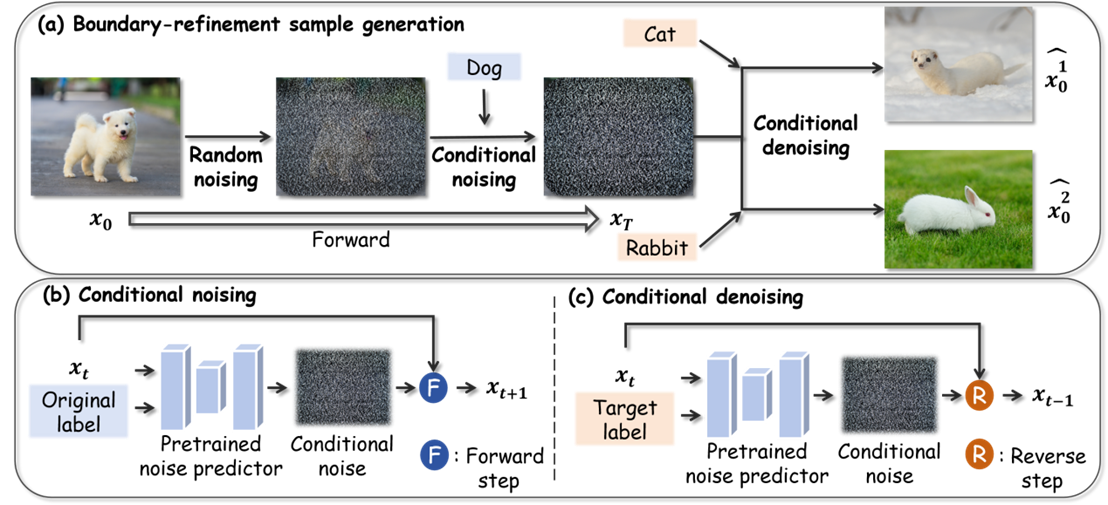

27. Decision Boundary-aware Generation for Long-tailed Learning

长尾数据会使分类器的决策边界偏向头部类别,从而削弱尾部类别的识别精度。基于扩散模型的生成式数据增强方法通过生成额外样本来缓解这一问题。然而,我们发现,尽管头尾迁移有助于在整体上平衡分类器的决策空间,但同时也会引入潜在的非局部特征混合,使不同类别的特征发生纠缠,导致决策边界重叠以及尾部类别分布偏移。针对这一现象,我们首先明确提出了“边界模糊”问题,并进一步设计了决策边界感知生成(DBG)框架。该框架通过生成具有信息量的近边界样本,强化模型对决策边界附近表征的学习能力。DBG在重平衡长尾数据分布的同时,使决策空间更加可分离,从而提升长尾学习效果。在多个标准长尾基准数据集上的实验结果表明,DBG在降低类别间重叠的同时,稳定提升了尾部类别精度及整体准确率。

该论文的第一作者是厦门大学信息学院2025级博士生杨嘉诚,通讯作者是卢杨长聘副教授,由2024级硕士张瑞弛、2025级硕士尚驰凯、李梦柯(深圳大学)、尚心怡(UCL)、高俊龙助理教授以及张永岗(香港科技大学)共同合作完成。

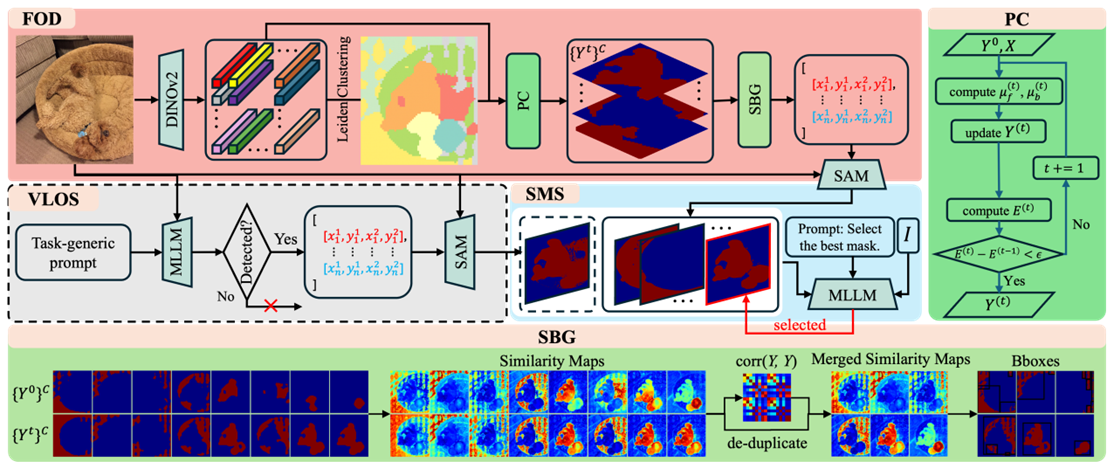

28. Discover, Segment, and Select: A Progressive Mechanism for Zero-shot Camouflaged Object Segmentation

现有的零样本伪装物体分割方法通常采用“先发现后分割”的两阶段流水线:即先利用多模态大语言模型(MLLMs)获取视觉提示,随后进行 SAM(Segment Anything Model)分割。然而,仅依赖 MLLMs 进行伪装物体发现往往会导致定位不准、误报和漏检等问题。为解决这些问题,本文提出了 Discover-Segment-Select (DSS,发现-分割-选择) 机制,这是一种旨在逐步细化分割结果的渐进式框架。该方法包含以下三个核心模块:特征一致性物体发现(FOD)模块:利用视觉特征生成多样化的物体候选提案(proposals);分割模块:通过 SAM 分割对这些提案进行细化;语义驱动掩码选择(SMS)模块:利用 MLLMs 从多个候选掩码中评估并筛选出最佳结果。在无需任何训练或监督的情况下,DSS 在多个 COS 基准测试中均达到了当前最先进的水平,尤其是在多实例场景中表现出色。

该论文第一作者是厦门大学信息学院博士后研究员杨一龙,通讯作者是曹刘娟教授,由2025级硕士生田剑心,张声传教授共同合作完成。

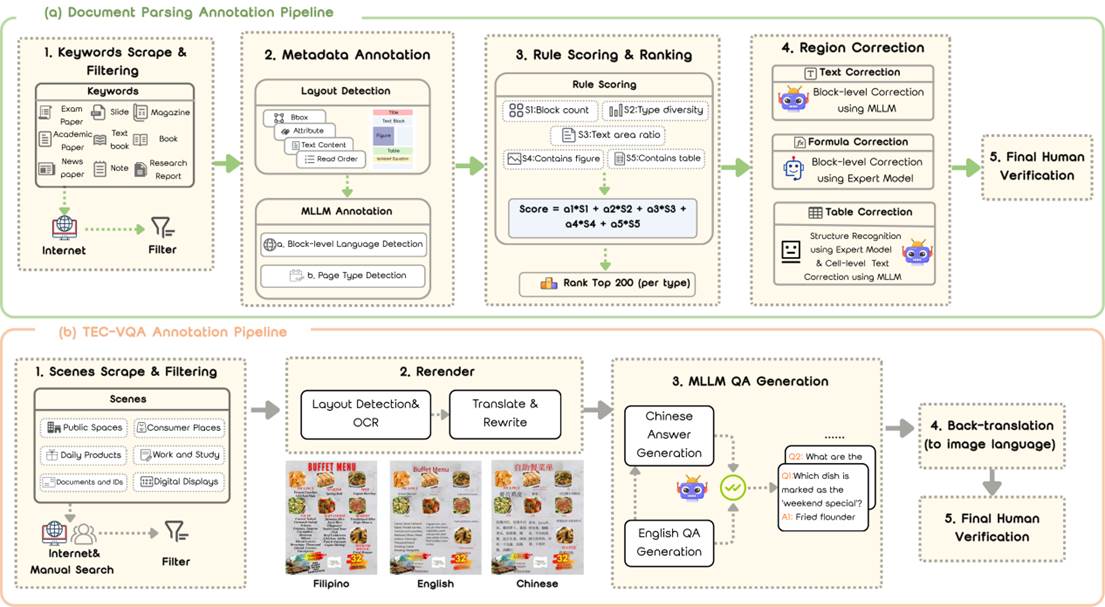

29. SEA-Vision: A Multilingual Benchmark for Comprehensive Document and Scene Text Understanding in Southeast Asia

本文聚焦多语言文档与场景文本理解在检索、金融和公共服务等应用中的关键作用,指出现有基准多偏向高资源语言,难以在真实多语言环境下评测模型能力。针对东南亚地区语言高度多样、书写系统复杂且文档类型差异显著带来的评测挑战,本文提出了多语言基准 SEA-Vision,面向 11 种东南亚语言,联合评测文档解析(Document Parsing)与以文本为中心的视觉问答(TEC-VQA)。本文构建了两类核心数据:其一为 15,234 页文档解析数据,覆盖 9 类代表性文档,并提供页面级、块级、行级的层次化标注;其二为 7,496 组 TEC-VQA 问答对,系统考察文本识别、数值计算、对比分析、逻辑推理与空间理解等能力。为在多语言、多任务场景下实现可扩展的高质量标注,本文设计了面向文档解析与 TEC-VQA 的混合式标注流水线,结合自动化筛选与评分、基于 MLLM 的辅助标注以及轻量级母语者核验,在显著降低人工成本的同时保证标注质量。进一步的评测结果表明,现有多种主流多模态模型在低资源东南亚语言上的性能明显下降,揭示了多语言文档与场景文本理解的显著差距。本文认为,SEA-Vision 将为推动文档与场景文本理解的全球化研究提供新的视角,促进该领域的持续发展。

该论文共同第一作者是人工智能研究院2023级硕士岳鹏飞、赵星然(Shopee)、陈君涛(同济大学),通讯作者是张声传副教授,由2023级博士生林将航、侯鹏(Shopee)、曹刘娟教授等共同合作完成。

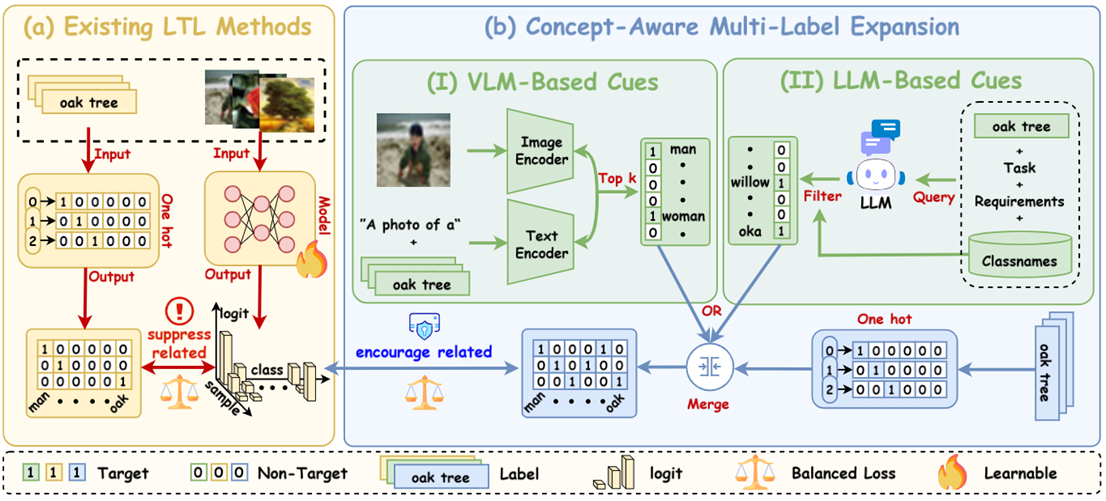

30. CUE: Concept-Aware Multi-Label Expansion to Mitigate Concept Confusion in Long-Tailed Learning

在真实世界的识别任务中,数据通常呈现长尾分布,即少数头部类别样本充足而大量尾部类别样本稀缺。尽管近年来通过微调基础模型在长尾学习中取得了显著进展,但现有方法大多仅关注缓解类别分布不平衡带来的偏置问题,而忽视了由单标签监督互斥性引发的类别概念混淆现象,导致相关类别之间特征共享受限、头部类别主导效应增强,从而破坏类别间判别结构。针对这一问题,本文提出概念感知多标签扩展方法CUE,通过引入多标签概念信号以恢复类别间语义关系。具体而言,CUE结合零样本CLIP提取的实例级视觉线索与大语言模型生成的类别级语义线索构建概念集合,并分别通过加权的BLA辅助损失进行建模,与基础LA损失联合优化。实验结果表明,CUE在多个长尾基准数据集上实现了更加均衡且具有竞争力的整体性能,优于近期先进方法。

该论文的共同第一作者是厦门大学信息学院2024级硕士生张瑞弛和2025级硕士生尚驰凯,通讯作者是卢杨长聘副教授,由2025级博士生杨嘉诚、李梦柯(深圳大学)、周阳(A*STAR)、高俊龙助理教授共同合作完成。